Yıl: 2014-2

Sayı: 99

Çok ilkel olarak, verilen bir lineer fonksiyonun bir özvektörü, bu fonksiyon altında ölçeklenen vektörler olarak tanımlanabilir; bu durumda ölçekleme miktarına da özvektörün özdeğeri denir. Daha titiz tanımları ve örnekleri başlangıçta vereceğiz. Bir lineer fonksiyonun özdeğerlerini ve bu özdeğerlere sahip özvektörlerini, determinantı kullanarak tanımlanan karakteristik polinomlar yoluyla bulacağız.

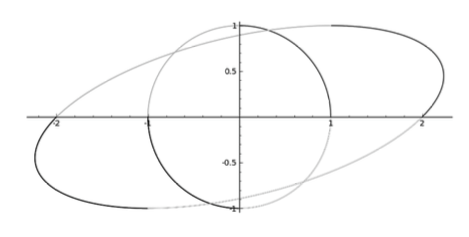

Önceki bölümde $$\begin{pmatrix} 2 & 1 \\ 0 & 1 \end{pmatrix}$$ matrisine karşılık gelen lineer dönüşüm altında $y = 0$ doğrusu üzerindeki vektörlerin uzunluklarının iki kat arttığını ve $y = -x$ doğrusu üzerindeki vektörlerin oldukları gibi kaldıklarını görmüştük. Okurumuz aşağıdaki tanıma geçmeden birim çemberin bu dönüşüm altındaki görüntüsü üzerine biraz düşünmeli:

Tanımlar ve İlk Örnekler

Tanım 6. Bir $ f : V \rightarrow V $ lineer fonksiyonu verilsin. Eğer bir $v \in V$ ve $\lambda \in \mathbb{R}$ için $f(v) = \lambda v$ oluyorsa, $v$’ye $f$’nin bir özvektörü ve eğer $v \neq 0_{V}$ ise $\lambda$’ya da $v$’nin bir özdeğeri denir. (Eğer $v \neq 0_{V}$ bir özvektörse tanımdaki gibi olan $\lambda$’ya $v$’nin özdeğeri demekte bir sorun yok, çünkü $f(v) = \lambda v$ eşitliğini sağlayan sadece tek bir tane $\lambda$ olabilir.)

Sıfır vektörünün her zaman bir özvektör olduğuna dikkat edelim. Biz özvektör deyince çoğunlukla sıfır olmayan vektörlerle ilgileneceğiz.

Örnek 9. İlk olarak $I_{2}$ birim matrisinin verdiği fonksiyona bakalım. Yani bu fonksiyon her $v \in\mathbb{R}^2$ vektörünü kendisine gönderecek. Bu durumda her vektör bir özvektör olur ve sıfır vektörü dışındaki her vektörün özdeğeri $1$ olur.

Örnek 10. Bir önceki örnekten bir adım öteye gidip köşegen matrislerle verilen lineer fonksiyonlara bakalım: $$A = \begin{pmatrix} a_{11} & 0 & \cdots & 0 \\ 0 & a_{22} & \cdots & 0 \\ \vdots & \vdots & \ddots & \vdots \\ 0 & 0 & \cdots & a_{nn} \end{pmatrix}$$

Bu matrisle belirlenen $f$ fonksiyonunun bir vektöre etkisi şöyle olur: $$\begin{pmatrix} v_{1} \\ v_{2} \\ \vdots \\ v_{n} \end{pmatrix} \mapsto \begin{pmatrix} a_{11}v_{1} \\ a_{22}v_{2} \\ \vdots \\ a_{nn}v_{n} \end{pmatrix}\ . $$

Bu durumda $i = 1, \ldots , n$ için $f(e_{i}) = a_{ii}e_{i}$ olur. Yani $e_{1},\ldots,e_{n}$ özvektörlerdir ve $e_{i}$’nin özdeğeri $a_{ii}$’dir.

Örnek 11. Sırada daha somut bir örnek var. $$\begin{split}f\;:\; \mathbb{R}^2 \; &\rightarrow \quad\mathbb{R}^2\\ \begin{pmatrix} x \\ y \\ \end{pmatrix} &\mapsto \begin{pmatrix} x + y \\ y \\ \end{pmatrix} \end{split}$$ lineer fonksiyonuna bakalım. Diyelim ki $$ f \begin{pmatrix} x \\ y \\ \end{pmatrix} = \lambda \begin{pmatrix} x \\ y \\ \end{pmatrix} = \begin{pmatrix} \lambda x \\ \lambda y \\ \end{pmatrix}$$ olacak şekilde $x$, $y$, $\lambda$ olsun. Bu durumda $x+y=\lambda x$ ve $y=\lambda y$ olmalı. Eğer $y \neq 0$ ise bu eşitliklerin ikincisinden $\lambda=1$ olduğu çıkıyor. Bu durumda da $x+y=x$, yani $y=0$ olur. Demek ki $y \neq 0$ durumu mümkün değil. Demek ki $y=0$ ve $x=\lambda x$. Özdeğerlerden bahsetmemiz için $x \neq 0$ olmalı. Yani $\lambda=1$ olduğunu görürüz. Özetle $f$’nin tek özdeğeri $1$ ve özvektörleri de $$ \left(\begin{array}{l}

x \\ 0 \end{array}\right) $$ formundaki vektörlerdir. Bu şekildeki vektörlerin kümesinin bir altuzay belirlediğine dikkat edelim.

Örnek 12. Şimdi $V$, $\mathbb{R}$’den $\mathbb{R}$’ye giden türevlenebilir fonksiyonlardan oluşan uzay ve $D$ de türev alma fonksiyonu olsun. Bu fonksiyonun bir özvektörü $F(x)=e^{\lambda x}$ olur, çünkü $$ D(F(x))=\lambda e^{\lambda x}=\lambda F(x)\ . $$

Bu özvektörün özdeğeri $\lambda$ olur. Ayrıca bu özvektörün bir skaler katının da özvektör olduğuna dikkat edelim. Yani $G(x)=r e^{\lambda x}$ olarak tanımlanan fonksiyonun türevi $\lambda G(x)$ olur.

Yukarıda da ipucunu verdiğimiz gibi verilen bir $\lambda$’nın özdeğeri olduğu vektörlerin kümesi, bir altuzay olur.

Önerme 3. Bir $f: V \rightarrow V$ lineer fonksiyonu ve $\lambda \in \mathbb{R}$ verilsin. O zaman $$ V_{\lambda}:=\{v \in V: f(v)=\lambda v\} $$ kümesi $V$’nin bir altuzayıdır.

Kanıt. Yapmamız gereken keyfi alınan $v_{1}, v_{2} \in V_{\lambda}$ ve $r \in \mathbb{R}$ için $v_{1}+v_{2}$ ve $r v_{1}$ vektörlerinin de $V_{\lambda}$’da olduğunu göstermek. Bunu $v_{1}+v_{2}$ ve $r v_{1}$ vektörlerini $f$’de değerlendirerek rahatlıkla gösterebiliriz:

$$f\left(v_{1}+v_{2}\right)=f\left(v_{1}\right)+f\left(v_{2}\right)=\lambda v_{1}+\lambda v_{2}=\lambda\left(v_{1}+v_{2}\right),$$ $$ f\left(r v_{1}\right)=r f\left(v_{1}\right)=r \lambda v_{1}=\lambda\left(r v_{1}\right) \ . \quad \square $$

Tanım 7. Yukarıdaki önermedeki gibi tanımlanan uzaya, $\lambda$’nın özuzayı diyeceğiz.

Her $\lambda$ için $V_{\lambda}$’nın içinde $0_{V}$ var; onun dışındaki bütün vektörler de özdeğeri $\lambda$ olan özvektörler. Fakat çoğu $\lambda$ için $V_{\lambda}$’nın içinde $0_{V}$’den başka vektör yok.

Önerme 4. Bir $ f: V \rightarrow V$ lineer fonksiyonu verilsin. Eğer $v_{1},\ldots,v_{n}$ özdeğerleri sırasıyla, birbirinden farklı $\lambda_{1}, \ldots, \lambda_{n}$ olan özvektörlerse $v_{1}, \ldots, v_{n}$ lineer bağımsızdır.

Kanıt. Bunu, $n$ üzerine tümevarımla kanıtlayacağız. Eğer $n=1$ ise $v_{1} \neq 0$ olduğu için lineer bağımsızdır.

Şimdi $n-1$ için sonucun doğru olduğunu varsayıp $n$ için gösterelim. Diyelim ki $r_{1} v_{1}+\cdots+r_{n} v_{n}=0_{V}$ olacak şekilde $r_{1}, \ldots, r_{n} \in \mathbb{R}$ olsun. Şimdi bu vektöre $f$’yi uygulayalım: $$ \begin{aligned}

f\left(r_{1} v_{1}+\cdots+r_{n} v_{n}\right) & =r_{1} f\left(v_{1}\right)+\cdots+r_{n} f\left(v_{n}\right) \\

& =r_{1} \lambda_{1} v_{1}+\cdots+r_{n} \lambda_{n} v_{n} \\

& =f\left(0_{V}\right) \\

& =0_{V} \end{aligned} $$

Bir de $r_{1} v_{1}+\cdots+r_{n} v_{n}=0_{V}$ eşitliğinin her iki tarafını $\lambda_{n}$ ile çarpıp $$ r_{1} \lambda_{n} v_{1}+\cdots+r_{n} \lambda_{n} v_{n}=0_{V} $$ elde edelim. Bu eşitliği de bir öncekinden çıkartarak

$$r_{1}\left(\lambda_{1}-\lambda_{n}\right) v_{1}+\cdots+r_{n-1}\left(\lambda_{n-1}-\lambda_{n}\right) v_{n-1}=0_{V}$$ elde edilir. Şimdi $v_{1}, \ldots, v_{n-1}$ vektörlerinin lineer bağımsız olduğunu bildiğimiz için her $i$ için $$ r_{i}\left(\lambda_{i}-\lambda_{n}\right)=0 $$ olduğu ortaya çıkar. Yani, $\lambda_{i}-\lambda_{n} \neq 0$ olduğundan $$ r_{1}=\cdots=r_{n-1}=0 $$ elde ederiz. Bunları bir üstteki eşitlikte yerine koyarak $r_{n}$’nin de $0$ olduğunu görürüz. $\quad \square$

Sonuç 4. Eğer $V$ sonlu boyutlu bir vektör uzayıysa her $f: V \rightarrow V$ lineer fonksiyonunun sonlu sayıda özdeğeri vardır.

Kanıt. Aksi takdirde yukarıdaki önermeden dolayı sonsuz tane lineer bağımsız vektör bulabilirdik. $\quad \square$

Karakteristik Polinom ve Matris Benzerliği

Kare bir $A$ matrisinin bir özvektörü $A v=\lambda v$ olacak şekildeki bir $v \in \mathbb{R}^{n}$ vektörüdür; eğer $v \neq 0_{\mathbb{R}^{n}}$ ise $\lambda$’ ya $A$’nın bir özdeğeri denir. Bir başka deyişle $A$’nın belirlediği lineer fonksiyonun özvektör ve özdeğerleri $A$’nın özvektör ve özdeğerleridir.

Örnek 10’da köşegen bir matrisle verilen lineer fonksiyonun özdeğerlerinin köşegendeki değerler olduğunu görmüştük. Yapmak istediğimiz birçok matris için işe yarayan bir yöntemle, verilen matrisin özdeğerlerini bozmadan onu köşegen bir matrise dönüştürmek. Bu muğlak ifadeyi biraz aşağıda daha titiz olarak açıklayacağız ama ilk olarak bu yöntemin, daha önceden yaptığımız Gauss hamleleriyle indirgenmiş eşelon forma getirmek olmadığına dikkat çekelim. Örneğin her tersinir matrisi Gauss hamleleriyle birim matrise dönüştürebiliriz ama özdeğerleri 1’den farklı olan matrisler olduğu aşikâr.

Peki bir lineer fonksiyonu farklı tabanlara göre temsil eden matrislerin özdeğerleri fonksiyonunkinden farklı olabilir mi? Olabileceğini bir örnekle gösterelim.

Örnek 13. Birim fonksiyonunun tek özdeğerinin $1$ olduğu açık. Mesela $\mathbb{R}^{2}$ üzerindeki birim fonksiyona şu tabanlara göre iliştirilen matrise bakalım: $$ B_{1}:= \left\{ \left(\begin{array}{l}

1 \\

0

\end{array}\right) ,

\left(\begin{array}{l}

0 \\

1

\end{array}\right) \right\} \qquad B_{2}:= \left\{ \left(\begin{array}{l}

1/2 \\

\hphantom{1}0

\end{array}\right) ,

\left(\begin{array}{l}

\hphantom{1}0 \\

1/2 \end{array}\right) \right\}

$$

Bu matris $$

M_{I d, B_{1}, B_{2}}=\left(\begin{array}{cc}

2 & 0 \\

0 & 2

\end{array}\right) $$ olur. Bu matrisin tek özdeğerinin de $2$ olduğu açıktır. Demek ki lineer fonksiyonlara farklı tabanlara göre iliştirilen matrislerin özdeğerleri farklı olabiliyor.

Bu örnekte neyi değiştirirsek özvektörleri koruyabiliriz? Bunu da bir sonraki örnekte görelim.

Örnek 14. Yine $\mathbb{R}^{2}$ üzerindeki birim fonksiyonu alalım ama bu sefer her iki tarafta da yukarıdaki $B_{2}$ tabanını alalım; yani daha önceki notasyonla $M_{I d, B_{2}, B_{2}}$ matrisine bakalım. Bu matrisin birim matris olduğunu görmek kolay. Aslında iki tarafta da aynı tabanı aldığımızda hep birim matrisi elde ediyoruz. Genel olarak da benzer bir durum olacak ama çok basit olduğundan bu örnek üzerinde neler olduğunu görmek zor. Daha karmaşık bir örnek yapalım.

Örnek 15. Yukarıda tek özdeğerini $1$ olarak bulduğumuz şu fonksiyona bakalım:

$$

\begin{aligned}

f\;:\; \mathbb{R}^2 \; &\rightarrow \quad\mathbb{R}^2 \\

\left(\begin{array}{c}

x \\

y

\end{array}\right) & \mapsto\left(\begin{array}{c}

x+y \\

y

\end{array}\right)

\end{aligned}

$$

ve şu $B$ için $M_{f, B, B}$’yi bulalım

$$ B= \left\{ \left(\begin{array}{c}

1 / 2 \\

0

\end{array}\right),\left(\begin{array}{l}

0 \\ 1 \end{array}\right) \right\}\ . $$

Bu matris $$ \left(\begin{array}{ll}

1 & 2 \\

0 & 1\end{array}\right) $$ olur ve tek özdeğeri -aynen $f$ gibi- $1$ olur. Genel olarak bunu söyleyebilir miyiz? Yani lineer bir $f$ fonksiyonuna bir $B$ tabanına göre iliştirilen $M_{f, B, B}$ matrisinin özdeğerleri $f$’ninkilerle aynı mıdır? Cevap olumlu ama bunu göstermek için birkaç yeni kavram geliştirmemiz gerekiyor.

Tanım 8. Bir $t$ değişkeni sabitleyelim. Verilen bir $n \times n$’lik $A$ matrisinin karakteristik polinomu $A-t I_{n}$ matrisinin determinantıdır. Bu polinomu $p_{A}(t)$ şeklinde göstereceğiz.

Bu determinantın değerinin gerçekten de $t$ değişkeninde bir polinom olduğuna dikkat edelim. Aşağıda yapacağımız örneklerde bu daha iyi anlaşılacaktır ama ilk önce bu tanımın ne işe yaradığını anlayalım.

Teorem 6. Verilen $\lambda$ gerçel sayısının bir $A$ matrisinin bir özdeğeri olması için gerek ve yeter koşul $\lambda$’nın $p_{A}(t)$ polinomunun bir kökü olmasıdır.

Kanıt. İlk olarak $\lambda$’nın $A$’nın bir özdeğeri olduğunu varsayalım ve $A v=\lambda v$ olacak şekilde sıfır olmayan bir $v \in \mathbb{R}^{n}$ alalım. Bu durumda $A v-\lambda v=0_{\mathbb{R}^{n}}$ olur. Yani $\left(A-\lambda I_{n}\right) v=0_{\mathbb{R}^{n}}$ denkleminin $0_{\mathbb{R}^{n}}$ olmayan bir çözümü olduğundan

$$ \operatorname{det}\left(A-\lambda I_{n}\right)=0$$

olmalıdır. Bu da $\lambda$’nın $A$’nın karakteristik polinomunun bir kökü olması demektir.

Şimdi tersine $\lambda$, $A$’nın karakteristik polinomunun bir kökü olsun. Bu durumda $\operatorname{det}\left(A-\lambda I_{n}\right)=0$ olacağından $\left(A-\lambda I_{n}\right) v=0_{\mathbb{R}^{n}}$ olacak şekilde sıfırdan farklı bir $v$ vektörü vardır. Yani $A v=\lambda v$ olduğundan $\lambda$, $A$’nın bir özdeğeridir. $\quad \square$

Bu teoremle birlikte artık matrislerin özdeğerlerini bulmanın sistematik bir yolunu biliyoruz. Ama yine de şunu aklımızdan çıkartmayalım: ikinci dereceden polinomların köklerini bulmak oldukça kolay ve üçüncü ve dördüncü dereceden polinomlar için de benzer yöntemler var ama beşinci ve daha büyük dereceden polinomların katsayılarına bağlı olarak yalnızca radikaller ve dört işlem kullanılarak o polinomların köklerini ifade etmenin bir yolu yok. Bir de bazı polinomların gerçel bir kökü olmayabilir; mesela $t^{2}+1$ polinomu gibi. Aslında sadece buna ‘benzer’ polinomların kökü yok ve o kökleri ‘ekleyerek’ bütün polinomların kökü olmasını sağlayabiliriz. Bunu yapmanın yolu gerçel sayılar yerine karmaşık sayılarla çalışmak. Burada karmaşık sayılar hakkında çok fazla bir şey söylemeyeceğiz; sadece –kanıtını vermeden– şunu hatırlayalım.

Teorem 7 (Cebirin Temel Teoremi). Katsayıları karmaşık sayı olan ve sabit olmayan her polinomun karmaşık bir kökü vardır.

Elimizdeki özdeğer bulma yöntemini birkaç örnekte test edelim.

Örnek 16. Şu matrisin özdeğerlerini ve özvektörlerini bulalım: $$ A=\left(\begin{array}{rr}

-1 & 2 \\

2 & -1

\end{array}\right) \ .$$

Bu matrisin karakteristik polinomu şu determinantla verilir: $$\operatorname{det}\left(\left(\begin{array}{rr} -1 & 2 \\

2 & -1

\end{array}\right)-\left(\begin{array}{ll}

t & 0 \\

0 & t \end{array}\right)\right) $$ Yani $p_{A}(t)=t^{2}+2 t-3$. Bu polinomun köklerinin de $1$ ve $-3$ olduğu kolayca görülür.

Özdeğeri $1$ olan özvektörleri hesaplayalım. $$ \left(\begin{array}{rr} -1 & 2 \\

2 & -1

\end{array}\right)\left(\begin{array}{l}

x \\ y

\end{array}\right)=\left(\begin{array}{c}

-x+2 y \\

2 x-y \end{array}\right) $$ Yani $$ \left(\begin{array}{c} -x+2 y \\

2 x-y \end{array}\right)=\left(\begin{array}{l}

x \\ y \end{array}\right) $$ olmalı. Buradan da $x=y$ elde ederiz. Bu durumda da özdeğeri $1$ olan vektörlerin $\left(\begin{array}{c}x \\ x\end{array}\right)$ biçimindeki vektörler olduğu sonucu çıkar.

Şimdi de özdeğerleri $-3$ olan özvektörleri bulalım. Bu sefer de $$ \left(\begin{array}{c} -x+2 y \\ 2 x-y

\end{array}\right)=\left(\begin{array}{l}

-3 x \\

-3 y \end{array}\right)$$ olmalı. Buradan da $y=-x$ olduğu çıkar. Yani özdeğeri $-3$ olan vektörler $\left(\begin{array}{c}x \\ -x\end{array}\right)$ formundadır.

Örnek 17. Sırada $3 \times 3$’lük matrislerin özdeğerleri var. Şu matrise bakalım:

$$

B=\left(\begin{array}{ccc}

2 & 1 & 0 \\

0 & 1 & -1 \\

0 & 2 & 4

\end{array}\right) \ .

$$

Bu matrisin karakteristik polinomu şu determinanttır:

$$

\operatorname{det}\left(\begin{array}{ccc}

2-t & 1 & 0 \\

0 & 1-t & -1 \\

0 & 2 & 4-t

\end{array}\right) \ .

$$

Hesapladığımızda $p_{B}(t)=(2-t)^{2}(3-t)$ çıkar. Yani özdeğerler $2$ ve $3$’tür.

Özdeğeri $2$ olan bir vektör alalım: $$ \left(\begin{array}{c} x \\

y \\

z \end{array}\right) $$ Yani $$ \left(\begin{array}{c} 2 x+y \\

y-z \\

2 y+4 z

\end{array}\right)=\left(\begin{array}{c}

2 x \\

2 y \\

2 z \end{array}\right) . $$ Buradan da özdeğeri $2$ olan özvektörlerin $$ \left(\begin{array}{c}

x \\

0 \\

0 \end{array}\right) $$ formunda olduğu anlaşılır.

Benzer biçimde özdeğeri $3$ olan özvektörlerin de

$$

\left(\begin{array}{c}

x \\

x \\

-2 x

\end{array}\right)

$$

formundaki vektörler olduğunu görebiliriz.

Daha fazla ilerlemeden Teorem 7’nin şu sonucunu kaydedelim.

Sonuç 5. Girdileri karmaşık sayı olan her matrisin özdeğeri karmaşık sayı olan en az bir özvektörü vardır.

Bunu gerçeller için söyleyebilir miyiz? Hayır! Gerçel özdeğerleri olmayan, gerçel katsayılı bir matris örneği olarak şunu verelim:

$$

\left(\begin{array}{cc}

0 & -1 \\

1 & 0

\end{array}\right) \ .

$$

Bu matrisin özdeğerleri $t^{2}+1$ polinomunun kökü olan $\sqrt{-1}$ ve $-\sqrt{-1}$ sayılarıdır.

Şimdi matrislerin özdeğerlerini bulmak için bir tekniğimiz var. Polinomların kökünü bulmak çok kolay olmasa da en azından karmaşık sayı özdeğerlerin varlığını biliyoruz. Peki ya lineer fonksiyonlar? Matrisler hakkındaki bilgilerimiz lineer fonksiyonlar hakkında doğrudan bir şey söylemiyor; ayrıca bir lineer fonksiyonu veren çok sayıda matris var, hangisini seçeceğiz? Daha önceden herhangi bir taban seçmenin doğru sonucu vermediğini birkaç örnekle göstermiştik ve doğru sonucun iki tarafta da aynı tabanı alarak olabileceği ipucunu vermiştik. Şimdi bunu kanıtlayalım.

Önerme 5. $n \times n$’lik $A$ ve $B$ matrisleri verilsin. Eğer $B$ tersinirse $A$’nın karakteristik polinomu ile $B^{-1} A B$’nin karakteristik polinomları aynıdır. Sonuç olarak da $A$ ile $B^{-1} A B$’nin özdeğerlerinin aynı olduğu çıkar.

Kanıt. Şu eşitlikler silsilesi, istediğimiz sonucu verir: $$ \begin{aligned}

\operatorname{det}\left(A-t I_{n}\right) & =\operatorname{det}\left(B^{-1}\left(A-t I_{n}\right) B\right) \\

& =\operatorname{det}\left(B^{-1} A B-t B^{-1} B\right) \\

& =\operatorname{det}\left(B^{-1} A B-t I_{n}\right) \ . \qquad \square

\end{aligned} $$

Bu önerme sonucunda verilen bir $f: V \rightarrow V$ lineer fonksiyonunun karakteristik polinomunu $V$’nin herhangi bir $B$ tabanı için $M_{f, B, B}$ matrisinin karakteristik polinomu olarak tanımlarız.

Tanım 9. Verilen $A$, $C$ matrisleri için eğer $$C=B^{-1} A B$$ olacak şekilde tersinir bir $B$ matrisi varsa $A$ ile $C$ benzerdir denir.

Yine yukarıdaki önermeye göre şunu söyleyebiliriz.

Sonuç 6. Benzer matrislerin karakteristik polinomları ve özdeğerleri aynıdır.

Bu arada şuna da dikkat edelim: Benzer matrisler satır denktir ama tersi doğru değildir. Mesela $I_{n}$ ve $2 I_{n}$ matrisleri satır denktir, ama -özdeğerleri farklı olduğundan- benzer olamazlar.

Köşegenleştirme

Tanım 10. Bir $f: V \rightarrow V$ lineer fonksiyonu verilsin. Eğer $V$’nin $f$’nin özvektörlerinden oluşan bir tabanı varsa $f$ köşegenleştirilebilir denir. Bir $A$ matrisinin verdiği lineer fonksiyon köşegenleştirilebilirse $A$ köşegenleştirilebilir denir.

Bu özelliğe niçin köşegenleştirmek diyoruz? Diyelim ki özdeğerleri sırasıyla $\lambda_{1}, \ldots, \lambda_{n}$ olmak üzere $v_{1}, \ldots, v_{n}$ özvektörleri $V$ uzayının bir tabanı olsun. O zaman $f$’ye bu tabana göre iliştirilen matris

$$

\left(\begin{array}{cccc}

\lambda_{1} & 0 & \ldots & 0 \\

0 & \lambda_{2} & \ldots & 0 \\

\vdots & \vdots & \ddots & \vdots \\

0 & 0 & \ldots & \lambda_{n}

\end{array}\right)

$$

olur. Yukarıdaki Önerme 5’ten dolayı bu köşegen matrisin özdeğerleri $f$’nin özdeğerleriyle örtüştü. Yani bu yolu özdeğerleri bulmak için kullanabiliriz. Ama elemanları özvektör olan bir taban bulmak oldukça dertli bir iş. Ayrıca bunu her zaman yapamayabiliriz. Mesela Örnek 17’deki matrisle verilen fonksiyonun köşegenleştirilmesine imkan yok çünkü hem 2 hem de 3’ün özuzayları bir boyutlu. Yani üç tane lineer bağımsız özvektör bulunamaz.

Amacımız simetrik matrislerle verilen lineer fonksiyonların her zaman köşegenleştirilebileceğini göstermek. Bunu birkaç adımda yapacağız.

Tanım 11. Verilen $A = (a_{i j})_{i, j=1, \ldots, n}$ matrisinde her $i$, $j$ için $a_{i j}=a_{j i}$ oluyorsa $A$ simetriktir denir.

(Simetrik matrisleri “devriği kendisi olan matrisler” şeklinde de tanımlayabilirdik.)

Sonuç 5’ten dolayı her gerçel girdili matrisin en az bir karmaşık sayı özdeğeri vardır. Eğer matris simetrikse bu değer gerçel olmalı. Bunu göstermek için ilk olarak iç çarpım kavramını tanıtmalıyız. Bu kavramla daha sonraki bölümde daha fazla çalışacağız ama şimdilik sadece bize en çok gerekecek özellikleri üzerinde duracağız.

Tanım 12. Verilen $$ v=\left(\begin{array}{c}

v_{1} \\

\vdots \\

v_{n}

\end{array}\right) \quad \text {ve} \quad w=\left(\begin{array}{c}

w_{1} \\

\vdots \\

w_{n} \end{array}\right) $$

vektörlerinin iç çarpımı $v_{1} w_{1}+\cdots+v_{n} w_{n}$ sayısıdır ve $\langle v, w\rangle$ şeklinde gösterilir. Eğer $\langle v, w\rangle=0$ oluyorsa, $v$ ile $w$ vektörlerinin birbirlerine dik olduğu söylenir. Verilen bir $V \leq \mathbb{R}^{n}$ altuzayındaki her vektöre dik olan vektörlerin kümesi $V^{\perp}$ ile gösterilir.

Bu tanımda vektörlerin girdileri gerçel ya da karmaşık sayı olabilir. Eğer vektörler gerçelse iç çarpımları gerçel sayı olur. Aslında bu tanımı geçen sayıda lineer fonksiyonlara örnek verirken yapmıştık ama orada yukarıdaki notasyonu tanıtmamıştık. İki vektörün iç çarpımını şu şekilde de tanımlayabilirdik: $$ \langle v, w\rangle=v^{t} w $$

(Sağdaki çarpım, matris çarpımıdır.)

Son olarak şuna dikkat edelim: her $V \leq \mathbb{R}^{n}$ için $V^{\perp}$ de $\mathbb{R}^{n}$’nin altuzayıdır ve $V \cap V^{\perp}= \{ 0_{\mathbb{R}^{n}} \} $ olur.

Önsav 4. Eğer $A$ simetrik bir matrisse her $v, w \in$ $\mathbb{C}^{n}$ için $$ \langle A v, w\rangle=\langle v, A w\rangle $$ olur.

Kanıt. Şu hesap, istediğimiz sonucu veriyor:

$$

\begin{aligned}

\langle A v, w\rangle & =(A v)^{t} w \\

& =v^{t} A^{t} w \\

& =v^{t} A w \\

& =\langle v, A w\rangle \ . \quad \square

\end{aligned}

$$

Teorem 8. Simetrik bir $A$ matrisi verilsin. O zaman $A$’nın her karmaşık sayı özdeğeri gerçeldir. Eğer $\lambda$ böyle bir özdeğer ve $v \in \mathbb{C}^{n}$ özdeğeri $\lambda$ olan bir özvektörse $v_{1}, v_{2} \in \mathbb{R}^{n}$ olmak üzere $$ v=v_{1}+\sqrt{-1} v_{2} $$ şekilde yazıldığında $v_{1}$ ve $v_{2}$ de özdeğeri $\lambda$ olan özvektörler olur.

Kanıt. $A v=\lambda v$ olacak şekilde sıfır olmayan $v \in \mathbb{C}^{n}$ ve $\lambda \in \mathbb{C}$ alalım ve

$$

\begin{aligned}

v & =\left(\begin{array}{c}

a_{1} \\

\vdots \\

a_{n}

\end{array}\right) \\

& =\left(\begin{array}{c}

b_{1}+\sqrt{-1} c_{1} \\

\vdots \\

b_{n}+\sqrt{-1} c_{n}

\end{array}\right) \\

& =\left(\begin{array}{c}

b_{1} \\

\vdots \\

b_{n}

\end{array}\right)+\sqrt{-1}\left(\begin{array}{c}

c_{1} \\

\vdots \\

c_{n}

\end{array}\right) \\

& =v_{1}+\sqrt{-1} v_{2}

\end{aligned}

$$

olarak yazalım. (Burada $b_{i}$ ve $c_{i}$’ler gerçel sayı.)

Şimdi $\langle v, \bar{v}\rangle$’ye bakalım: (Burada da $\bar{v}$, $v$’nin her girdisinin karmaşık eşleniğini alarak elde edilen vektördür.)

$$\langle v, \bar{v}\rangle=a_{1} \bar{a}_{1}+\cdots+a_{n} \bar{a}_{n}=\left|a_{1}\right|^{2}+\cdots+\left|a_{n}\right|^{2}>0.$$

Bir de $\langle A v, \bar{v}\rangle$’ı hesaplayalım:

$$ \langle A v, \bar{v}\rangle=\langle\lambda v, \bar{v}\rangle=\lambda\langle v, \bar{v}\rangle $$

Son olarak da şuna dikkat edelim

$$ \bar{\lambda} \bar{v}=\overline{\lambda v}=\overline{A v}=\bar{A} \bar{v}=A \bar{v} . $$

Yani $$ \lambda\langle v, \bar{v}\rangle=\langle A v, \bar{v}\rangle =\langle v, A \bar{v}\rangle

=\langle v, \bar{\lambda} \bar{v}\rangle

=\bar{\lambda}\langle v, \bar{v}\rangle $$ olur ve $\langle v, \bar{v}\rangle \neq 0$ olduğundan $\lambda=\bar{\lambda}$ elde ederiz. Bu durumda da $\lambda \in \mathbb{R}$ olur.

Sırada $v_{1}$ ve $v_{2}$ vektörlerinin de özvektör olduğunu göstermek var:

$$ \lambda v_{1}+\sqrt{-1} \lambda v_{2} =\lambda v=A v =A\left(v_{1}+\sqrt{-1} v_{2}\right) =A v_{1}+\sqrt{-1} A v_{2}\ . $$

Her karmaşık sayının $1$ ve $\sqrt{-1}$’in tek bir lineer kombinasyonu olarak yazılabileceğini kullanarak

$$ \lambda v_{1}=A v_{1} \;\text { ve }\; \lambda v_{2}=A v_{2} $$

olduğunu elde ederiz ve $v$ sıfır vektörü olmadığı için $v_{1}$ ya da $v_{2}$’den biri sıfır vektörü değildir. Yani özdeğeri $\lambda$ olan ve sıfır olmayan gerçel özvektörler vardır. $\quad \square$

Tanım 13. Verilen bir $f: V \rightarrow V$ lineer fonksiyonu için $f(W) \subseteq W$ özelliğini sağlayan $W$ altuzaylarına $f$ altında değişmez denir.

Önsav 5. Simetrik bir $A$ matrisi ve özdeğeri $\lambda$ olan bir $v$ özvektörü alalım.

- Eğer $w \in \mathbb{R}^{n}$ ile birbirlerine dikse $Aw$ ile $v$ de birbirlerine diktir.

- Eğer $W \leq \mathbb{R}^{n}$, $f_{A}$ altında değişmezse $W^{\perp}$ de $f_{A}$ altında değişmezdir.

Kanıt. İlkini göstermek için şu hesap yeterli:

$$ \langle A w, v\rangle =\langle w, A v\rangle

=\langle w, \lambda v\rangle =\lambda\langle w, v\rangle =\lambda 0 =0 .$$

İkincisini göstermek için $u \in W^{\perp}$ alalım. O halde her $w \in W$ için

$$ \langle A u, w\rangle=\langle u, A w\rangle=0 $$

olur. (Son eşitlik $A w \in W$ olduğu için doğru.) O zaman da $A u \in W^{\perp}$ olur; yani $W^{\perp}$, $f_{A}$ altında değişmezdir. $\quad \square$

Elimizdeki bilgilerle kanıtlamak istediğimiz köşegenleştirme sonucu oldukça kolay oluyor.

Teorem 9. $n \times n$’lik simetrik bir $A$ matrisi verilsin. O halde $V$’nin $A$’nın özvektörlerinden oluşan bir tabanı vardır. Hatta bu tabandaki vektörleri birbirlerine dik olacak şekilde de seçebiliriz.

Kanıt. Bunu $n$ üzerine tümevarımla kanıtlayacağız.

Teorem 8 kullanılarak bir $v_{1}$ özvektörü alalım ve $V_{1}=\left\langle v_{1}\right\rangle$ olsun. Eğer $n=1$ ise kanıtımız, $\mathbb{R}=V_{1}$ olduğu için burada biter.

Şimdi teoremin, boyutu $n$’den küçük uzaylar için doğru olduğunu varsayıp boyutu $n$ olan uzaylar için doğru olduğunu gösterelim. $V_{2}=V_{1}^{\perp}$ olsun. Bu uzayın, $n-1$ boyutlu olduğunu hatırlayalım. Yukarıdaki önsavdan dolayı, $A$ $V_{2}$’ye kısıtlanabilir ve bu şekilde elde edilen fonksiyon da lineer fonksiyondur. Tümevarım hipotezinden dolayı, $V_{2}$’nin $A$’nın özvektörlerinden oluşan dik bir tabanı vardır; bu tabana $B_{2}$ diyelim.

Şimdi $B:=\{ v_{1} \} \cup B_{2}$ kümesinin $\mathbb{R}^{n}$’nin dik bir tabanı olduğu açık ve bu tabanın bütün elemanları $A$’nın bir özvektörü. $\quad \square$

Şimdi bu yaptıklarımızı birkaç örnekle pekiştirelim.

Örnek 18. Şu matrisle verilen lineer fonksiyona bakalım:

$$

A=\left(\begin{array}{rr}

4 & -2 \\

1 & 1

\end{array}\right) .

$$

İlk olarak $A$’nın özdeğerlerini bulalım. Bu matrisin karakteristik polinomunun $t^{2}-5 t+6$ olduğu hesaplanabilir. Buradan da özdeğerlerin $2$ ve $3$ olduğu çıkar. Özdeğeri $2$ olan vektörler

$$

\left(\begin{array}{l}

x \\

x

\end{array}\right)=x\left(\begin{array}{l}

1 \\

1

\end{array}\right)

$$

formunda ve özdeğeri $3$ olan vektörler de

$$

\left(\begin{array}{c}

2 y \\

y

\end{array}\right)=y\left(\begin{array}{l}

2 \\

1

\end{array}\right)

$$

formundadır.

Şimdi

$$

v_{1}=\left(\begin{array}{c}

1 \\

1

\end{array}\right) \;\text { ve }\; v_{2}=\left(\begin{array}{l}

2 \\

1

\end{array}\right)

$$

vektörlerinin $\mathbb{R}^{2}$’nin bir tabanını oluşturduğu açık ve her ikisi de $A$’nın birer özvektörü. Şimdi de $A$’nın verdiği fonksiyonu bu tabana göre temsil eden matrise bakalım:

$$

f\left(v_{1}\right)=2 v_{1}+0 v_{2} \;\text { ve }\; f\left(v_{2}\right)=0 v_{1}+3 v_{2}

$$

olduğundan bu matris

$$

B=\left(\begin{array}{ll}

2 & 0 \\

0 & 3

\end{array}\right)

$$

köşegen matrisi olur. Şuna da dikkat edelim:

$$

A=\left(\begin{array}{ll}

1 & 2 \\

1 & 1

\end{array}\right) B\left(\begin{array}{ll}

1 & 2 \\

1 & 1

\end{array}\right)^{-1}

$$

Yani $A$ ile $B$ benzerler.

Örnek 19. Üç boyutlu şu kare matrise bakalım:

$$

A=\left(\begin{array}{rrr}

1 & 2 & 0 \\

2 & 1 & -1 \\

0 & -1 & 1

\end{array}\right) .

$$

Bu simetrik bir matris olduğundan köşegenleştirmenin mümkün olduğunu biliyoruz. İlk olarak özdeğerlerini bulalım. Karakteristik polinomu $(1-t)(t^{2}-2 t-4)$; yani özdeğerler $1$, $1+\sqrt{5}$, $1-\sqrt{5}$. Bunlara sırasıyla tekabül eden özvektörler de

$$

\begin{aligned}

& v_{1}=\left(\begin{array}{l}

1 \\

0 \\

2

\end{array}\right), \qquad v_{2}=\left(\begin{array}{c}

1 \\

\sqrt{5} / 2 \\

-1 / 2

\end{array}\right), \qquad v_{3}=\left(\begin{array}{c}

1 \\

-\sqrt{5} / 2 \\

-1 / 2

\end{array}\right) .

\end{aligned}

$$

Yine bir önceki örnekte olduğu gibi $A$’nın

$$

\left(\begin{array}{ccc}

1 & 0 & 0 \\

0 & 1+\sqrt{5} & 0 \\

0 & 0 & 1-\sqrt{5}

\end{array}\right)

$$

matrisine benzer olduğu birkaç işlemden sonra görülebilir.

Bir de köşegenleştirilemeyen bir fonksiyon inceleyelim.

Örnek 20. Şu matrisin verdiği lineer fonksiyona bakalım:

$$

\left(\begin{array}{lll}

2 & 1 & 1 \\

0 & 1 & 1 \\

0 & 0 & 1

\end{array}\right)

$$

Bu matris, bir üçgensel matris olduğu için özdeğerlerinin köşegen değerleri olduğunu biliyoruz; yani özdeğerler $2$ ve $1$. Özdeğerleri $2$ olan vektörler şu vektörün skaler katlarıdır:

$$

v_{1}=\left(\begin{array}{l}

1 \\

0 \\

0

\end{array}\right).

$$

Özdeğerleri $1$ olanlarsa şu vektörün skaler katlarıdır:

$$

v_{2}=\left(\begin{array}{r}

1 \\

-1 \\

0

\end{array}\right) .

$$

Bu durumda bütün özvektörlerin oluşturduğu altuzay 2 boyutludur. Yani $\mathbb{R}^{3}$’ün, $A$’nın özvektörlerinden oluşan bir tabanı olamaz. Bu da $A$’nın verdiği lineer fonksiyonun köşegenleştirilememesi demektir.

Örnek 21. Bir de matrisle verilmeyen bir örneğe bakalım. Sürekli fonksiyonlar uzayının $\cos x$ ve $\sin x$ ile gerilen, iki boyutlu altuzayına $V$ diyelim ve bu uzay üzerindeki türev fonksiyonuna bakalım. Yani $f: V \rightarrow V$ verilen bir $a \cos x+b \sin x$ vektörünü $b \cos x-a \sin x$ vektörüne gönderiyor. Diyelim ki $v=a \cos x+b \sin x$ özdeğeri $\lambda$ olan bir özvektör. Bu durumda

$$\lambda=\frac{b}{a}=-\frac{a}{b}$$

olmalı. Yani $b= \pm \sqrt{-1} a$ olmalı. Bu durumda da $\lambda= \pm \sqrt{-1}$ olur. Yani $v$, şu vektörlerden birisinin skaler katıdır:

$$ \cos x+\sqrt{-1} \sin x \;\text { ya da }\; \cos x-\sqrt{-1} \sin x . $$

Ama bu fonksiyonun hiçbir gerçel özdeğeri ya da gerçel özvektörü yok. Bunun yanında karmaşık sayı girdili vektörler olarak düşünüldüğünde bu fonksiyonu köşegenleştirmek mümkündür.